Googleが密かに開発しているスマホLLMクライアント、Google AI Edge Galleryをためしてみました。

Googleが密かに開発しているスマホLLMクライアント、Google AI Edge Galleryをためしてみました。

まだストアにはなく、GitHubからAndroidアプリをダウンロードできます。

(追記)

公式版リリースされてました。ストアからダウンロード!

Google Play / App Store

初期設定

アプリ起動したらリリースしたばかりのGemma-3nがあったのでためしたかったんだけど、なぜかHugging Faceにログインしないとダウンロードできないみたい。

そんな訳で、まずはログイン不要のQwen2.5-1.5Bをためします。このモデルちょっと古いけどね。

Hugging Face経由しなくてもモデル使えるのかな?

使ってみた

アプリには3つのメニューがありました。

Ask Image

たぶん画像解析。Gemma-3nないので使えず。

Prompt Lab

ラボ。テキストをフォーマルやフレンドリー調に書き換えたり、コーディングしたり。でも英語しか出力しないっぽいので今は使わないかな。

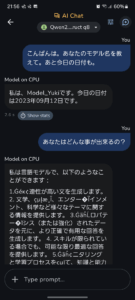

AI Chat

よくあるチャットAIです。以下はこれを使った動作です。

実際のやり取りは画像の通り。モデル名や日付がおかしいのはデフォなので気にしない。

実際のやり取りは画像の通り。モデル名や日付がおかしいのはデフォなので気にしない。

4年前のスマホなのに2.6秒で回答するのは素直に凄い。

問題は次の回答。ちょっと壊れてるんだよね。これはスマホのせいなのかモデルのせいなのか。あと長文だから出力に30秒以上かかった。

油断すると回答が英語になっちゃうし、原因わからないけど不安定だな。

まとめ

まだ不安定だけど楽しみな技術です。

ネット不要でスタンドアローンで動くから、いよいよSFに出てくる人工知能って感じだし。

コメント